Bild: de.freepik.com

Es gibt auch in der Politik ein Leben nach der nächsten Wahl. Das Bundesministerium für Bildung und Forschung hat ein „Zukunftsbüro“ und einen „Zukunftskreis“ damit beauftragt, die Welt von morgen vorherzusagen. Was bringt dieser wissenschaftliche Blick in die Kristallkugel?

„Die Zukunft ist keine sauber von der jeweiligen Gegenwart abgelöste Utopie: Die Zukunft hat schon begonnen. Aber noch kann sie, wenn rechtzeitig erkannt, verändert werden.“ – Robert Jungk, Zukunftsforscher

„Die beste Methode die Zukunft vorherzusagen besteht darin, sie zu erfinden.“ – Alan Kay, Informatik-Pionier

Im Bundesministerium für Bildung und Forschung, kurz BMBF, hat man einen Plan. Ein neu eingerichtetes „Zukunftsbüro“ soll zusammen mit einem „Zukunftskreis“, einem interdisziplinären Expertengremium aus den Bereichen Wirtschaft, Wissenschaft, Kultur und Zivilgesellschaft, Szenarien erarbeiten – und zwar für „mögliche, wahrscheinliche und wünschenswerte Zukünfte“ bis zum Jahr 2030. 6,5 Millionen Euro lässt sich der Bund das für die kommenden drei Jahre kosten.

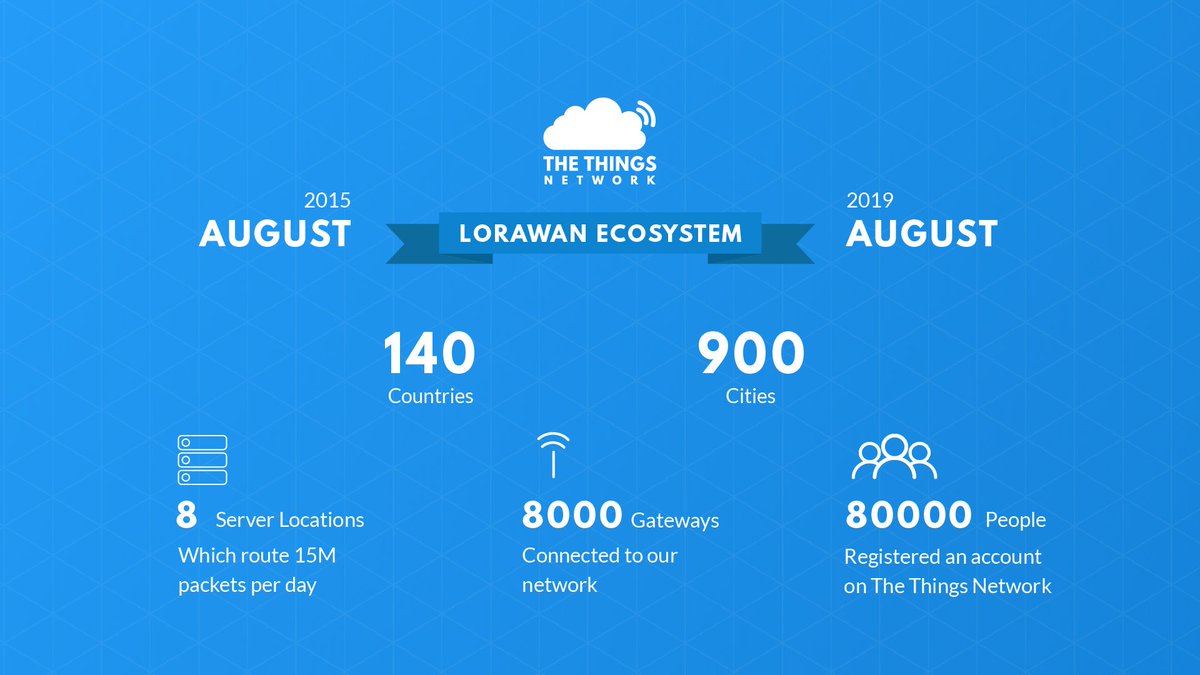

In einer ersten Studie sollen Veränderungen von Wertevorstellungen und neue Arten der Wertevermittlung in Deutschland untersucht werden. So weit, so abstrakt. Konkret könnte es dabei, zum Beispiel, darum gehen, auf wie viel Privatsphäre die Menschen verzichten würden, wenn es um ihre eigene, digitale unterstützte Gesundheit geht.

„Strategische Vorausschau“, auf Englisch: Foresight , nennt sich das neue Arbeitsfeld im BMBF, das gar nicht so neu ist. Es ist vielmehr eine Fortsetzung von zuvor angestoßenen „Foresight“-Prozessen aus den Jahren 2007 bis 2009 und 2012 bis 2014. Der erste Prozess hatte das Ziel, technologische Zukunftsfelder zu identifizieren. Beim zweiten wurde untersucht, wie diese mit dem gesellschaftlichen Alltag zusammenlaufen. Zu den Methoden bei der Vorausschau im Regierungsauftrag gehörten Literaturrecherchen, Experten-Interviews, Workshops und Analysen, also vorwiegend qualitative Methoden

Neun Geschichten aus dem Jahr 2030

Als Ergebnis wurden neun „Innovationskeime“ identifiziert, die 2015 in neun „Geschichten aus der Zukunft“ präsentiert wurden – ob über „Arbeitskollege Computer“, „Privatsphäre im Wandel“, „Kollaborativ-Wirtschaft“ oder „Deutschland Selbermachen“. Hier eine kleine Leseprobe aus der letztgenannten Geschichte:

Tinka öffnet den WerkRaum wie immer gegen 9:30 Uhr. Sofort beginnt es, aus der Kochecke zu brodeln, bunt zu blinken und zu pfeifen. Sie grinst. Scheinbar funktioniert das KaffeeBot nun endlich, nachdem die vier Mädels aus der Schule von nebenan wochenlang daran rumgebastelt hatten – da hat es wohl doch an dem optischen Sensor gelegen. „Wow!“ Bei näherer Betrachtung bemerkt sie, dass eine extragroße Menge Kaffee gekocht wird. Da haben die cleveren Mädels es doch tatsächlich geschafft, den Bot an den WerkRaum-Kalender anzuschließen, sodass er selbst erfasst hat, dass heute Morgen eine große Gruppe kommt.

Die Voraussage für 2030, auf der die Geschichte beruht, ist die Entstehung einer gesellschaftlichen Selbermachen-Bewegung, in der traditionelle handwerkliche Fähigkeiten auf neue Technologien wie 3D-Drucker treffen – gepaart mit dem Wunsch nach mehr Nachhaltigkeit. Bisher lässt sich sagen, dass die Maker-Kultur zwar weiterhin regen Zulauf erhält, eine riesige, deutschlandweite Bewegung aber noch nicht entstanden ist. Auch von einer dezentral organisierten „Kollaborativ-Wirtschaft“ (Sharing Economy) aus einer der anderen Geschichten sind wir noch entfernt. Aber bis 2030 ist ja auch noch ein bisschen Zeit.

Wie zutreffend waren frühere Prognosen?

In die Zukunft schaut die Bundesregierung schon seit den 1980er Jahren – und seitdem immer häufiger und in immer mehr Formaten. 1992 und 1998 wurden die ersten Delphi-Studien in Auftrag gegeben, deren Methodik weiter unten erklärt wird. Vereinzelte Foresight-Prozesse gibt es seit den 1990er Jahren. Ebenfalls seit dieser Zeit ist das Büro für Technikfolgen-Abschätzung beim Deutschen Bundestag als feste Institution angesiedelt. Und im Jahr 2000 rief die damalige Forschungsministerin, Edelgard Bulmahn, den „Forschungsdialog Futur“ ins Leben, um Leitvisionen für Forschung und Entwicklung zu erarbeiten.

Die Politik hat also reichlich Material, auf das sie bei Entscheidungen für die Gestaltung der Zukunft zurückgreifen könnte – zumal die beauftragten Experten oft richtig lagen. Vielen Thesen der älteren Delphi-Studien über mögliche Zukünfte sind auch heute noch plausibel.

Doch es gab natürlich auch Prognosen, die nicht eintrafen. Auf eine Insulinkapsel zum Einnehmen, die zwischen 2005 und 2011 erwartet wurde, oder eine HIV-Impfung, die spätestens 2019 verfügbar sein sollte, warten wir leider weiterhin. Auch ein „weltumspannendes Netzwerk zur Überwachung von Umweltbelastungen auf der ganzen Erde, insbesondere ihrer Ausbreitung, […] das 24 Stunden lang in Echtzeit Daten empfängt, diese Informationen integriert, systematisch analysiert und sie dann weltweit verbreitet“ ist in dieser integrierten Form noch nicht einsatzbereit, obwohl es für 2008 bis 2015 antizipiert wurde. Auch die Einrichtung einer europäischen Regierung, die nationalstaatliche Souveränität ablöst, galt mal als Megatrend.

Zur „Verteidigung“ der Gremien muss man sagen, dass viele Thesen auch damals als unrealistisch eingestuft wurden. Aber: Sie wurden zumindest mal gedacht.

Von Delphi bis Zukunftsrad: So kommen Zukunftsbilder zustande

Wie kommen diese Bilder der Zukunft überhaupt zustande? Und wie lassen sie sich auf ein gesundes Maß an Realismus eindampfen und sinnvoll bewerten? Der „Zukunftskreis“ bedient sich laut eigener Aussage vier klassischer Methoden der Vorausschau, um „Zukunft zu gestalten und gestaltbar zu machen“: „Delphi-Technik“, „Szenariotechnik“, „Visioning“ und „Futures Wheel“.

Bei der Delphi-Technik, die nach dem antiken Orakel von Delphi benannt ist, liegt der Schwerpunkt auf der Befragung einer Gruppe von Experten. Jeder soll dabei zu konkreten Thesen über mögliche Zukünfte Stellung nehmen. Waren alle einmal dran, werden sie anonym über die Antworten ihrer Kollegen informiert. Dann müssen sie sich erneut äußern. So soll über mehrere Runden eine möglichst differenzierte Bewertung entstehen, die möglichst frei ist von Gruppen- und Interessensdynamiken. Eine mögliche These, die man heute zur Debatte stellen könnte, wäre beispielsweise, dass der Anteil autonomer Fahrdienste am öffentlichen Nahverkehr im Jahr 2050 25 Prozent betragen wird.

Bei der Szenariotechnik geht es darum, mögliche Szenarien für die Zukunft zu entwickeln und zu antizipieren, wie wahrscheinlich ihr Eintreten jeweils ist – basierend auf unterschiedlich gewichteten Einflussfaktoren. Ein autonomer öffentlicher Nahverkehr, zum Beispiel, hängt davon ab, ob zentrale technische Probleme gelöst werden können, das Vertrauen der Menschen in autonome Fahrzeuge steigt, die rechtlichen Rahmenbedingungen geklärt sind und so weiter. Aber welcher Faktor ist wirklich entscheidend für den Durchbruch auf dem Massenmarkt? Hier müssen die Zukunftsforscher gewichten.

Beim Visioning geht es darum, eine Vision zu entwickeln oder eine gemeinsame Leitidee, wie eine wünschenswerte Zukunft aussieht. Solche Ideen dienen der Orientierung – kleinteiligere, weniger bedeutende Ziele werden ihr untergeordnet.

Das Futures Wheel oder Zukunftsrad ist eine einfache Methode, deren Kern die Frage „Was wäre, wenn?“ ist. Mit ihr lassen sich die möglichen Auswirkungen von denkbaren zukünftigen Entwicklungen erschließen. Ein Beispiel: Wäre die Annahme „E-Scootern gelingt der Durchbruch im Massenmarkt“, resultiert daraus vielleicht eine Verbesserung der Parksituation in den Innenstädten, weil die Menschen weniger Auto fahren. Daraus ließe sich schließen, dass der Bau neuer Parkhäuser wenig sinnvoll ist.

Ausgehend von einer zentralen These entsteht ein exploratives Bild möglicher Entwicklungen, die dann weiter diskutiert werden können. Die Wahrscheinlichkeit, mit der diese Entwicklungen eintreten, ist dabei erstmal weniger relevant. Vielmehr geht es darum, den Möglichkeitssinn der Teilnehmer zu aktivieren. Das Futures Wheel ist also eine spezielle Form des Brainstormings. Ach ja. Klar ist übrigens, dass die Realität beim Thema E-Scooter momentan ziemlich anders aussieht als in der Beispiel-These.

Trends geben Hinweise auf die Zukunft, aber existieren sie überhaupt?

Um die meisten der erklärten Techniken anzuwenden, braucht man erst einmal Thesen und Annahmen, mit denen man arbeiten kann. Um diese zu entwickeln, haben die meisten Methoden der Zukunftsforschung eines gemeinsam: Sie extrapolieren Annahmen aus der Vergangenheit in die Zukunft. Extrapolation heißt, dass Prognosen auf der Grundlage unsicheren Wissens abgegeben werden.

Trends gelten dabei als Hinweise auf die Zukunft, die im Hier und Jetzt beobachtet werden können. So heißt es auf der Website des Zukunftsinstituts, einem der führenden Trendforschungsinstitute Deutschlands: „Trends sind Bewegungen ‚in eine Richtung‘. Sie zu beobachten ist Aufgabe des Trendforschers, der versucht, frühe Anzeichen und bestimmte Muster zu erkennen. Trends muss man nicht voraussagen. Sie finden nicht in der Zukunft, sondern in der Gegenwart statt: Es sind Veränderungen, die man nicht prognostizieren, aber identifizieren muss.“

Der Zukunftsforscher Christian Neuhaus von der Freien Universität Berlin attestiert Trends in einem Beitrag für die Zeitschrift für Zukunftsforschung sogar, dass es sie eigentlich gar nicht gibt. Trends würden nur für den Beobachter selbst existieren, meint Neuhaus, seien aber „als solche“ nicht in der Welt existent. Der Trendforscher gehe davon aus, dass die aktuelle Entwicklung sich in der nahen Zukunft fortsetzen wird, was – trotz Untermauerung durch Daten, Interpretation und Analyse – schlichtweg ein Glaube sei. Dennoch hält Neuhaus Trendforschung für alles andere als unnütz.

Was hilft die Zukunftsforschung?

Stattdessen eröffnet für Neuhaus der bewusste Umgang mit Trends und ihrer eingeschränkten Aussagekraft Chancen beim Entscheiden und Planen in Organisationen – allein schon deshalb, weil man sich durch die Trendforschung systematisch mit Entwicklungen, möglichen Einflussfaktoren und der Zukunft auseinandersetzt. Der Nutzen der Trends liegt für Neuhaus also in der Orientierungsleistung, die zu besseren Entscheidungen führt.

Für die Bundesregierung heißt das: Sie könnte das Orientierungswissen, das ihr die Zukunftsstudien liefern, für eine vorausschauende, gestaltende Politik nutzen – und etwa deutlich gezielter Förderprogramme starten oder Forschung unterstützen. Ob bisher aber wirklich handfeste Politik aus der Zukunftsforschung im Regierungsauftrag entstanden ist, ist ein unsicheres Ding. Wie die Zukunft selbst eben.